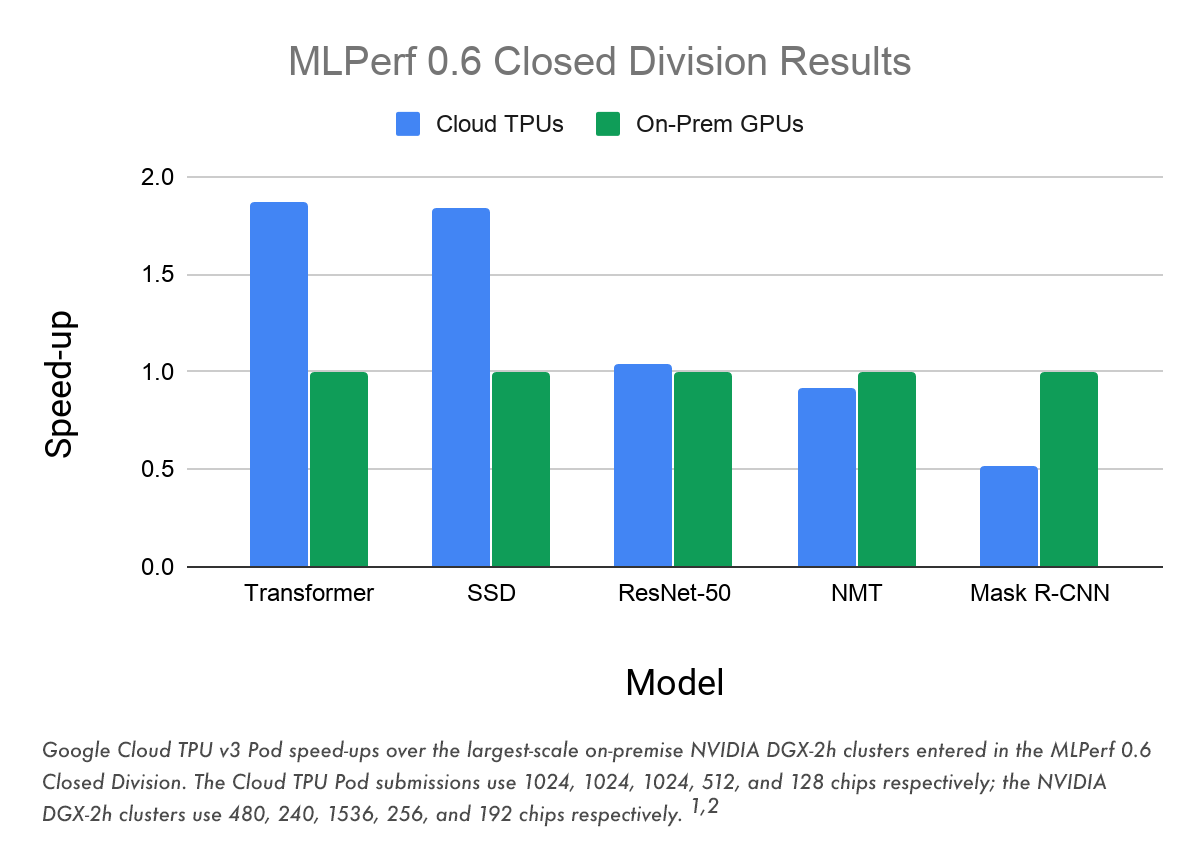

MLPerf 0.6での結果。

下記の画像は、上記記事からの引用です。

環境と実際の時間は、ここを見ると書いてあります。

ImageNet ResNet-50 v1.5の学習が Cloud TPU (1024個)で、1.28分、DGX-2H x96 (V100が1536個)で、1.33分

僅差で、Googleの勝ち。

Mask-R-CNN と NMT が勝っている模様。

TPUが1024個だと、8 Pod だし、V100が1536個だと、DGX-2H が96台だし、

これって、どう考えても普通なら無理ですね。

これって、どう考えても普通なら無理ですね。

TPU v8は、8ドル/1時間なので、1.28*1024/60*8=約175ドル。

Cloud TPU対応のモデルは、ここにありますね。