@Vengineerの戯言 : Twitter

SystemVerilogの世界へようこそ、すべては、SystemC v0.9公開から始まった

今日は、IntelのNNP-TとNNP-Iについて、既に公式から講演資料が公開されています。

Deep Learning Training At Scale

Spring Crest Deep Learning Accelerator

(Intel® Nervana™ NNP-T)

Spring Hill (NNP-I 1000)

Intel’s Data Center Inference Chip

Intel NNP-T

今回の NNP-T の発表では、下記の4つは新しい情報だと思います。

- Argonという DNN Kernel Library

- Tensor Processing Cluster (TPC)のブロック図

- Spring Crest Compute

- Spring Crest On-die Communication

Argonに関しては、

の中で、

・NNP Transformer => Argon

・iGPU Transformer => clDNN

・nGPU Transformer => CUDA/cuDNN

・PlaidML Transformer => LLVM / OpenCL / OpenGL / CUDA

とあったので、CUDAのcuDNNに相当するものですね。

Intel NNP-I

今回の NNP-I の発表では、下記の6つは新しい情報だと思います。

- ICE (Inference Compute Engine)は、12個

- ICEのブロック図と概略

- ICE内のDSPは、Cadence Tensilica P6

- メモリは、LPDDR4x (4x32, 2x64)

- 推論性能は、ResNet50 で 3600 Inferences Per Second (IPS)@10W (SOC level)

- 24MBのLLC

ResNet50での推論が 3600 IPS って、速いのかな?

このツイート によると、NVIDIAのT4で 10000 IPS なので NNP-I 3個分。NVIDIAのRTX 2080 Tiだと 25000 IPS なんだよね。となると、7倍だね。

まー、消費電力として10Wで3600 IPS ということで。。。

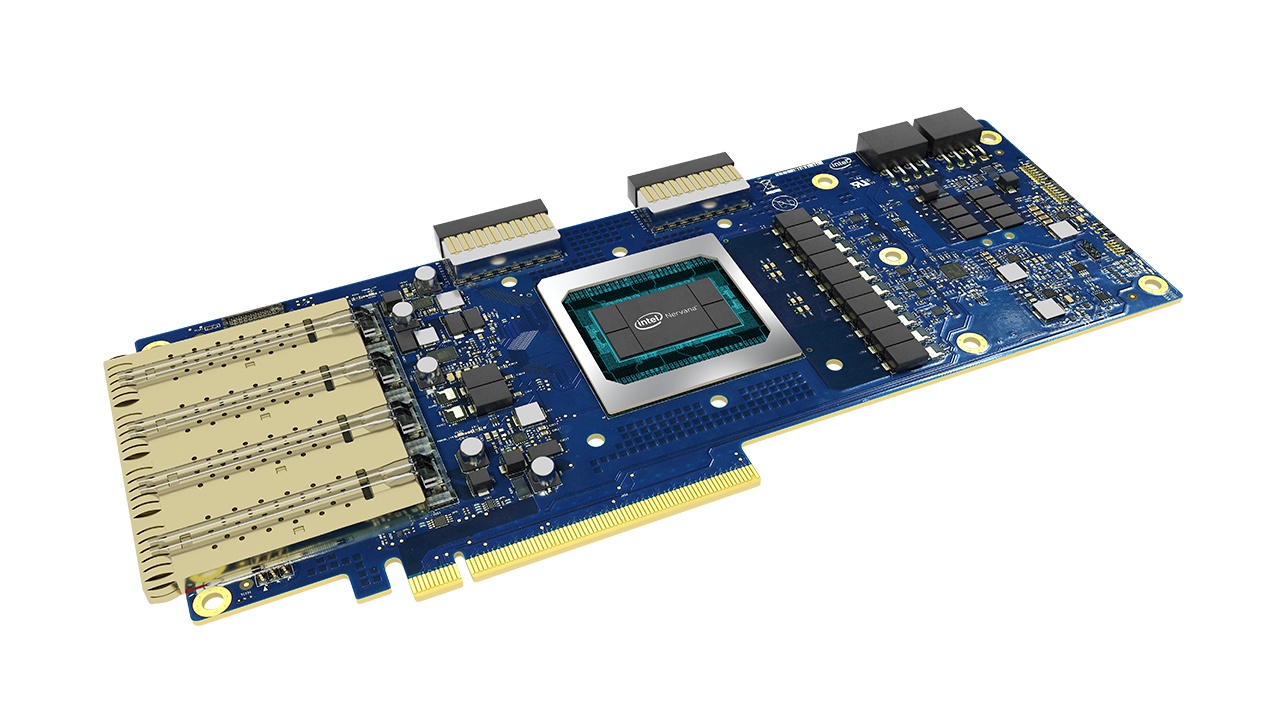

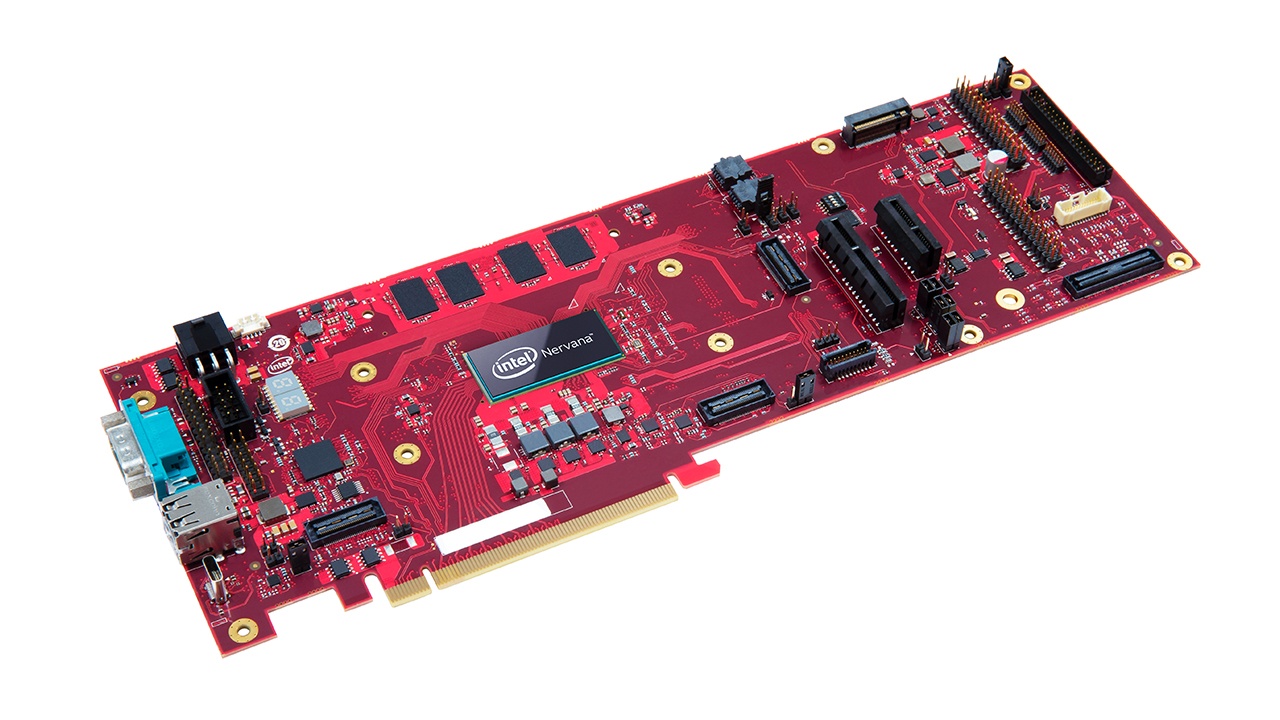

NNP-T/NNP-I、ともにPCIeボードがあるよ

には、NNP-T と NNP-I のPCIeボードもあるよ。

(引用:下記の画像は、URLを使って、組み込んでいます)

NNP-T:インターコネクト用の4個+2個のコネクタがありますね。

電源用コネクタも2つ。

NNP-I:NNP-Iの上の方にメモリが4個ありますね。右側には、PCIeのx4とx1のスロットがありますね。これって、PCH側にあるPCIeコントローラを使っているんでしょうね。