はじめに

AMDがMI300Xを発表しました。MI300Aに対して、CPU die x 3 の変わりの GPU die を追加し、GPU die が4つになります。また、メモリHBM3が各GPU dieに対して、24GB で 8個のHBM3 で 192GB搭載されています。

AMD Instinct

- MI100 : 2020.11、TSMC 7nm、750 mm²、HBM2(32GB)

- MI250X/M250 : 2021.11、TSMC 6nm、724 mm2、2 die、HBM2E(128GB)

- MI210 : 2021.12、TSMC 6nm、724 mm2、1 die、HBM2E(64GB)

- MI300A : 2022.6、TSMC 5nm/6nm、HBM3(128GB)

- MI300X : 2023.6、TSMC 5nm/6nm、HBM3(192GB)

- MI450X : 2024.6、TSMC 3nm ?

MI300A

MI300A の振り返りは、

に詳細があります。そこから下記の部分を引用します。

- AID (Active Interposer Device)

- ~370mm2

- TSMC N6

- 64MB Infinity Cache

- 2 HBM memory controllers

- 36 lanes of xGMI/PCIe/CXL

- AID の上に、GPU die と CPU die

- GPU : XCD

- ~115mm2

- TSMC N5

- CPU : Zen 4 CCD ベースで GMI3 PHY は無い

- ~70.4mm2

- TSMC N5

AID ( 370 mm2 ) の上に、GPU die x 2 ( 115 mm2 x 2 = 230mm2)、CPU die x 3 ( 70.4 mm2 x 3 = 211.2 mm2)

AID には、Infinity Cache が 64MB、MI250Xは1 GPU die で 8MB なので、2 GPU die で 16MB。つまり、MI300A では、Infinity Cache は 64MB x 3 = 192MB、MI250Xは 8MB x 2 = 16MB。

MI300X

MI300X は、GPU die x 4 なので、

- Infinity Cache : 64MB x 4 = 256MB

- HBM3 Memory : 24GB x 8 = 192GB

となります。

MI300Xの各AIDには、x36 GMI/PCIe/CXL が付いているので、x36 x 4になり、8個のMI300Xを x16 GMIにて全結合できそうです。

MI300X については、

でもとまっています。

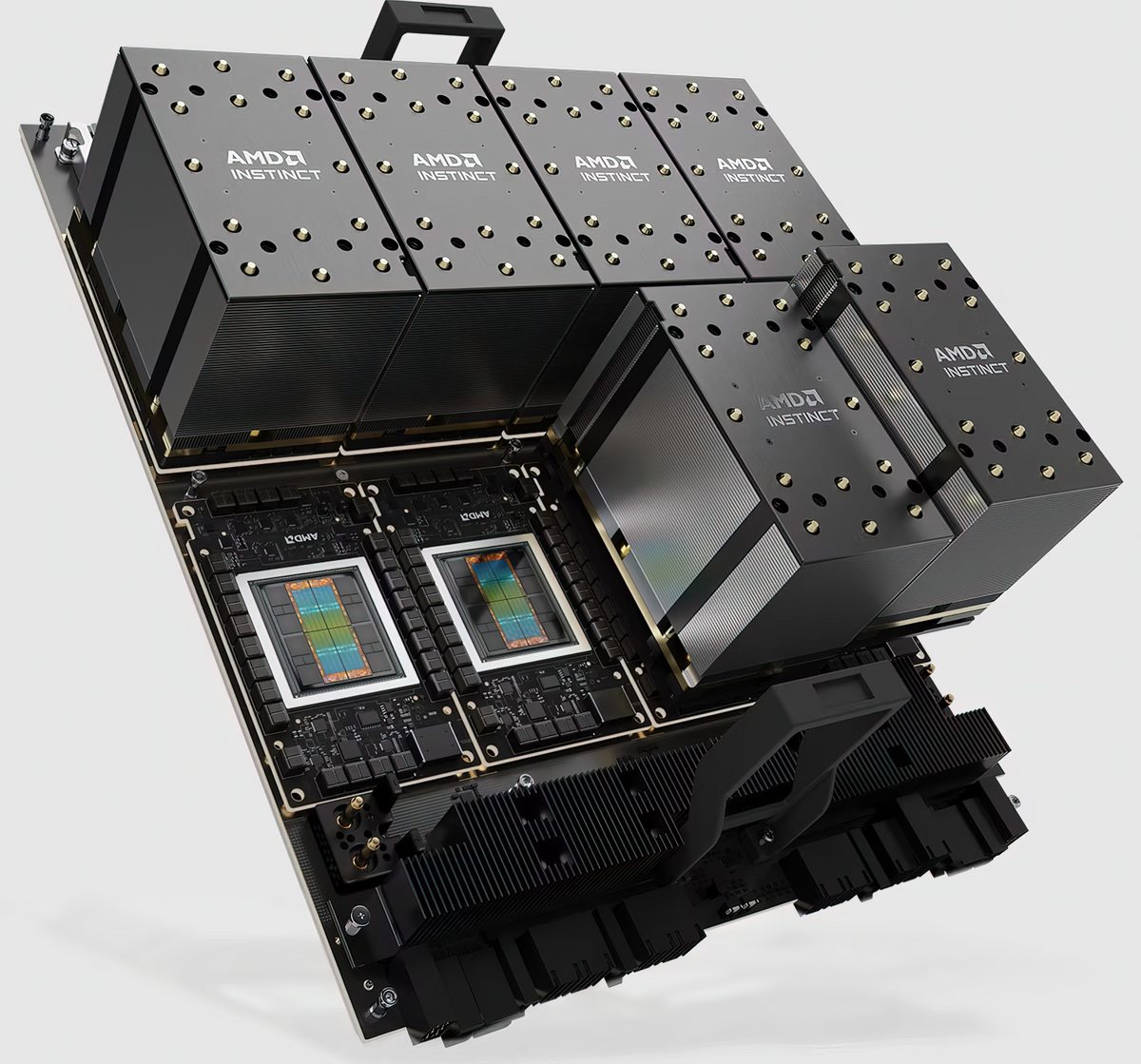

下記は、上記の記事から説明のために引用します。 MI300X x 8 です。HGX Form Factor Specification, Revision 1.0, Version 0.1 っぽいです。

HGX Form Factor Specificationをサポートしているものは、

# おわりに

AMDがMI300Aに続き、MI300Xを発表しました。MI300Aは現在Sampling中、MI300XはQ3にSamplingのようです。

DGX H100の対抗品が出てきた、AMD MI300X x8、さあどうなるのでしょうか?

SUPERMICROの8125GS-TNHRというのが 、

のシステムなので、Host CPU側は PCIe Gen5 かな?これを xGMI でもOKになっているのなら、そのまま使えそう。。。たぶん、それは想定していると思います。

関連ブログ https://vengineer.hatenablog.com/entry/2023/06/03/090000

追記)、2023.06.19

追記)、2023.06.23