はじめに

AWSのTrainiumとInferentia2については、ほぼ同じということをこのブログでも下記のように紹介しました。

今回、公開された Trainium と Inferentia2 の Board の写真から 2つのパッケージ(Dieの型番が同じ)は同じでBoardが違うということを知ることができました。

この投稿

下記の一連の投稿に、TrainiumとInferentia2のBoardの写真が掲載されました。

Spending the afternoon with the @awscloud custom silicon folks at Annapurna Labs here in Austin. Rami Sinno and Chetan Kapoor (overall EC2 PM lead) kicking off the event. $AMZN pic.twitter.com/61oSji82Ab

— Patrick Moorhead (@PatrickMoorhead) 2023年10月19日

以下の写真(図)は、上記の投稿内のものを説明のために引用します。

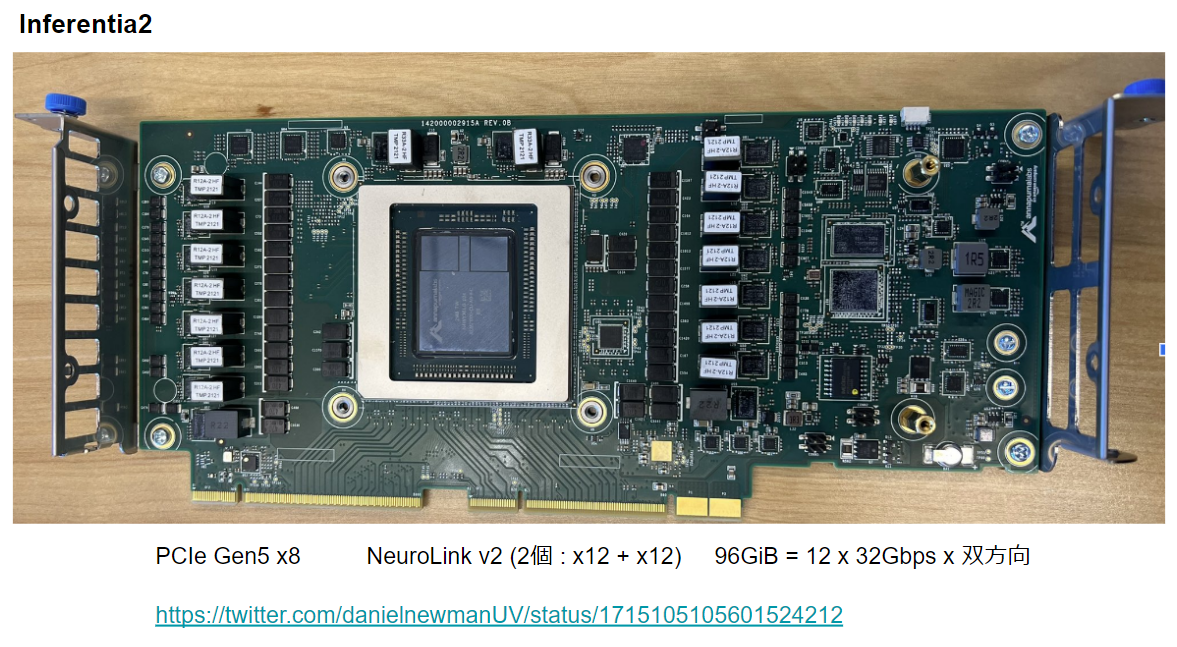

Inferentia2

PCIe Board ではありません。カードエッジが2組です。下記にカードエッジの部分の拡大です。表面に x8 の配線が3組、裏面からカードエッジにx8の配線が来ています。Inferentia2は、NeuronLink-v2が2組載っています。

1つのノードにこの基板が12枚刺さっています。

Board 間は NeuroLink v2 で接続しています。

カードエッジからは、x8 + x8 + x8 + x8 が出ています。ホストとの接続に x8 を使っているとすると、各ボードには x8 + x4 = x12 で接続しています。96GiB/sの帯域があるようです。x12 x 32Gbps x 双方向とすると、96GiB/s になります。32Gbps は、PCIe Gen5 と同じです。

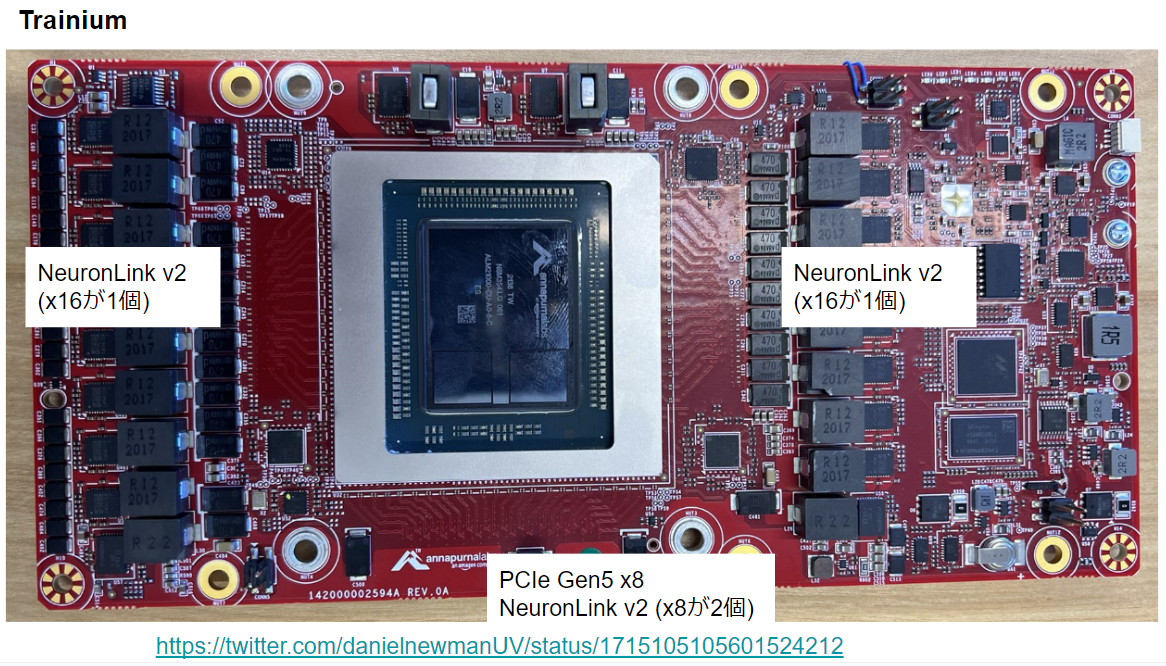

Trainium

両サイドに x16、下に x8 + x8 + x8 が出ています。

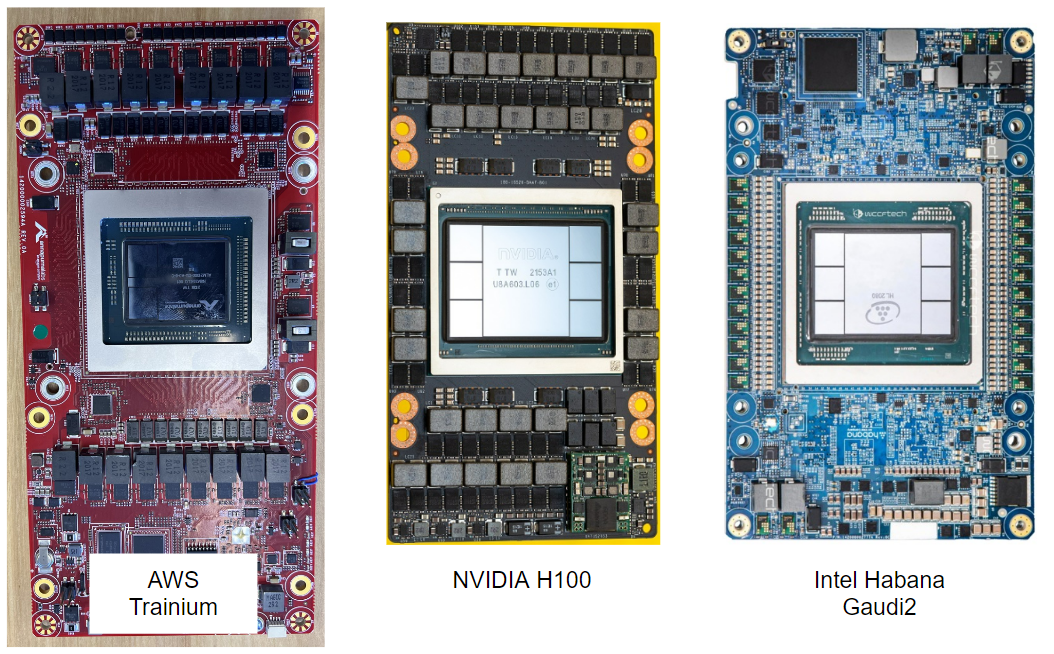

ボードのサイズ感です。NVIDIA H100 と Intel Habana Gaudi2 より長手方向に長いです。

裏面にはコネクタが3つです。

Trainium x 8個のBoardです。このBoardを2つで最大16個のTrainiumが2D Torus(右の図)で接続するようです。右の図でTrainium間の配線の色が黄色と黒色になっています。左の基板の縦長のコネクタには x8 + x 8 + x8 、横長のコネクタは x16 の線が来ています。となると、黄色の上下は x16 で接続し、黒色の左右は x8 で接続しているのでは?と妄想しています。

ホストとの接続は縦長の x8 (PCIe Gen5 x8) で接続しているのだと思います。

おわりに

AWSのTrainiumとInferentia2、似ているのということだったのですが、パッケージまで同じだったんですね。。。

と、次に続くのはどこでしょうか?