はじめに

かなり前に、FacebookがGlowという推論用のフレームワークを出して、その時盛り上がって、勉強会もした記憶があります。

これですね。

2018年11月28日なので、もうすぐ3年にもなるんですな。早いというか、そんな昔なのか?と。

Glow はまだ開発をしている

その Glow は、まだ、github では更新がされています。

どんなデバイスをサポートしているかというと、このコードの中での Backends としては、

- CPU

- Habana

- Interpreter

- NNPI

- OpenCL

です。ここにあるの、実は全部、Intelがらみではないでしょうか?

NNPIとは、Intel NNP-I です。Habana Labs を買収したことにより、Narvana Systems の NNP-T と Inte x86-64コアとCadenceのTensilica 搭載の NNP-I は EOL になりました。 しかしながら、NNP-I はこのGlowでまだ使われているということです。。HabanaもIntelに買収されちゃっているし、OpenCLはIntel GPUでも対応しています(サーバー用にはGPUが搭載されていないのでどのように使っているのかはわかりませんが)

Esperanto Technologies の ET-SoC-1 も Glow 対応?

今年のHotChips 33での Esperanto Technologies の講演、

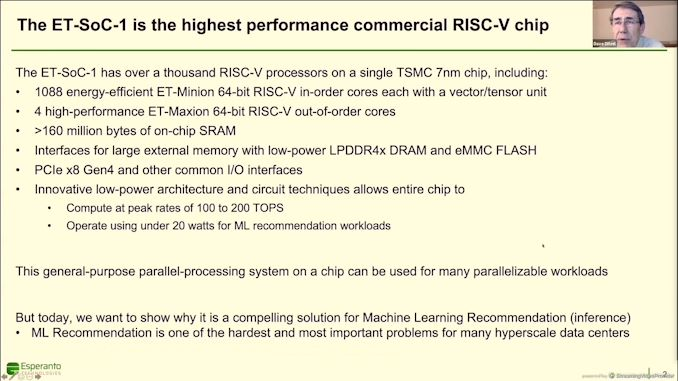

説明のために下記のスライドを引用します。このスライドに、ML recommendation workloads とあり、たぶん、Facebook がお客さん。

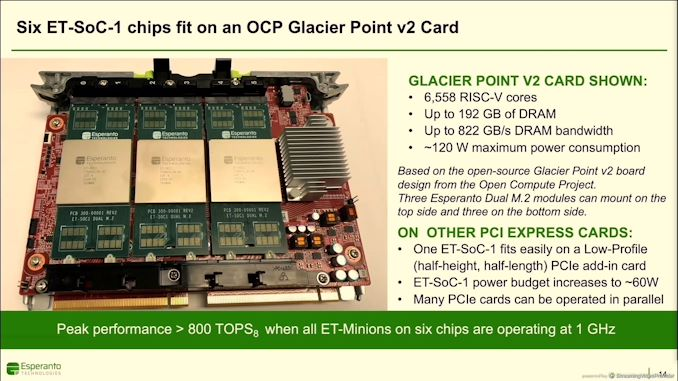

下記のスライドも説明のために引用します。このボードは、OCP Glacier Point v2 Card で Facebook が推奨しているシステム。。。

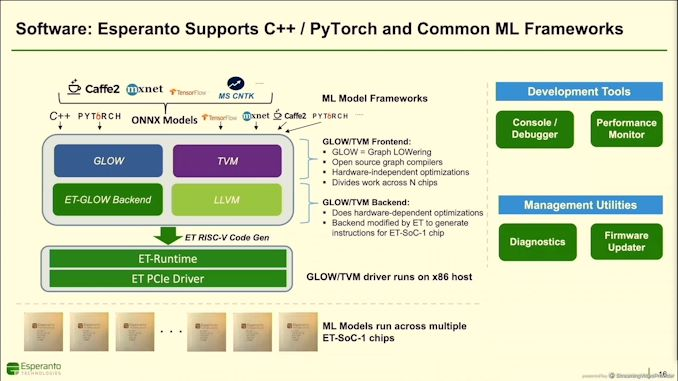

そして、Softwareのエコシステムのスライド。説明のために引用します。ここに、GLOW/ET-GLOW Backend と Glow をサポートしていることを明記しています。 Glowだけでなく、TVMもサポートしているようです。

Facebbook の Accelerating Infrastructure

2019年3月14日のFacebookのブログ:Accelerating Facebook’s infrastructure with application-specific hardware

ここの Inference の部分、Glacier Point v2. Yosemite v2 になればいいんですよね。

あ、EsperantoのET-SoC-1の Glacier Point v2 って、dual M.2 に 2個載っていて、Glacier Point v2では6チップなんだ。。。

Partner は、

These chips offer INT8 for workloads that need performance, as well as support for FP16, which enables higher precision.

とありました。

とありますね。Qualcommはどこに行ったのでしょうかね。

おわりに

Intel NNP-I、EOLなんだけど、まだ使われているのは、Esperanto の ET-SoC-1 が遅れちゃっているのが原因だと思います。

早ければ、今年中に置き換えられるのかしら