はじめに

NVIDIAがH200の性能を発表しました。

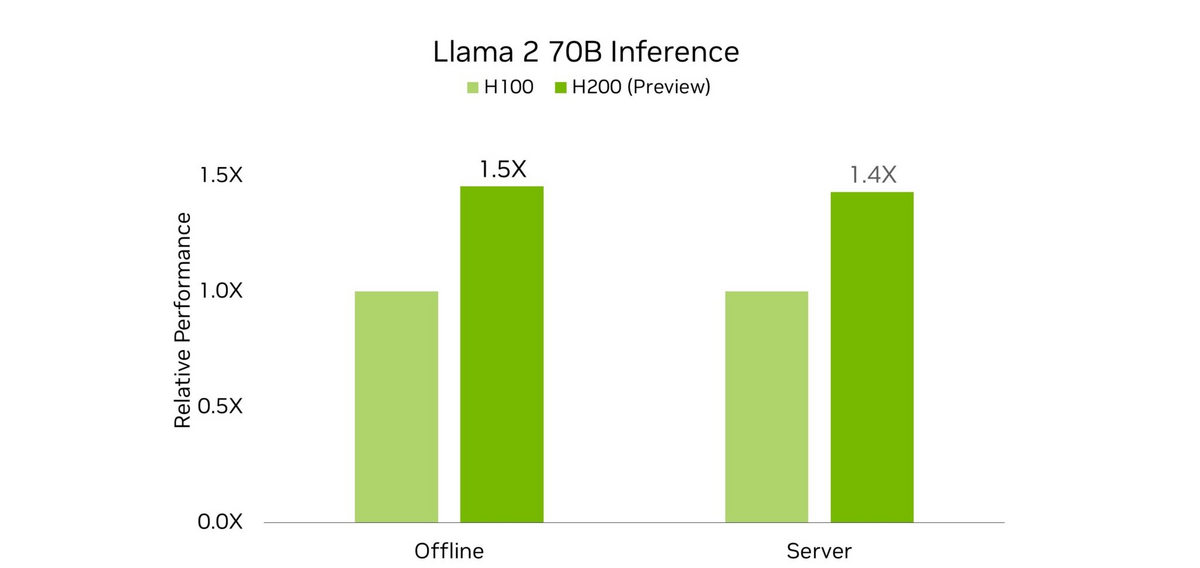

LIama2 70B の性能

下図は上記のNVIDIAのBlogから説明のために引用します。

H100に対して、

- Offline : 1.5倍

- Server : 1.4倍

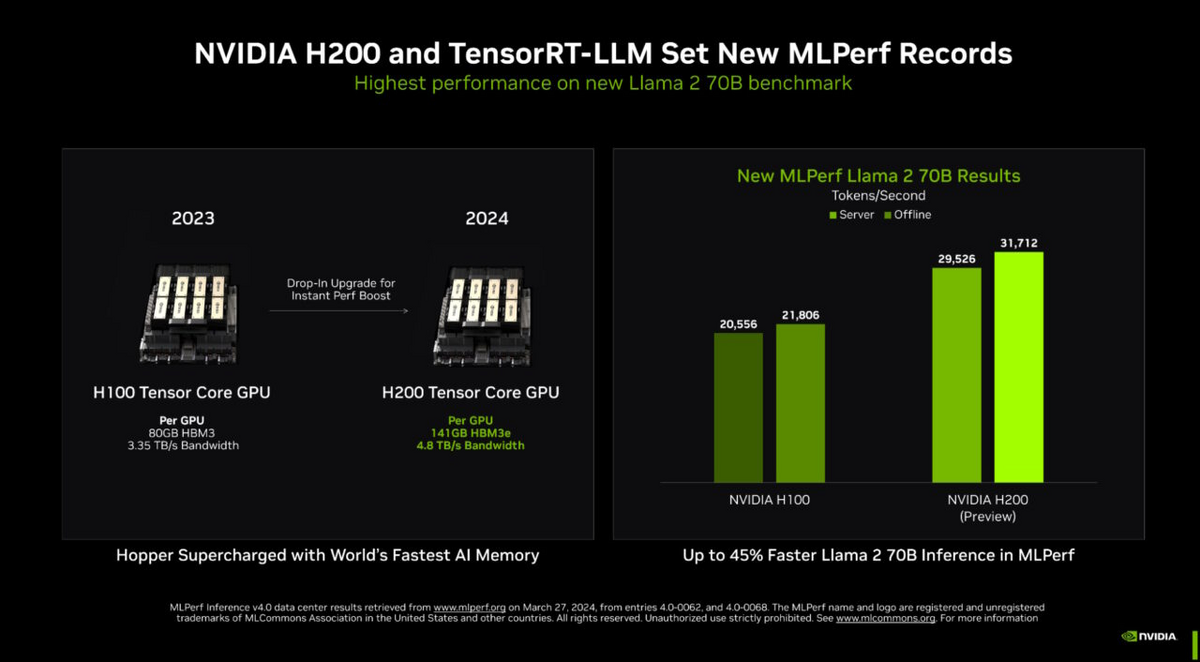

そして、もう一つ

下記の図は上記の記事から説明のために引用します。

H100からH200では、HBM3の80GB(3.35TB/s) から HBM3eの141GB(4.8TB/s) に強化。メモリ帯域は、1.43倍

一方、右のグラフは、LIama2 70B の MLPerf の結果

- H100 : 20,556/21,806

- H200 : 29,526/31,712

となり、1.43 - 1.45倍ぐらいなので、メモリ帯域が増えた分なのでしょうか?

あれ、最初のグラフ、Offline は 1.5倍、Server は 1.4倍になっているのは、四捨五入しているですね。。。

NVIDIAのH200のサイト。ここ。ここに下記の図があります。説明のために引用します。

こちらでは、LIama2 70Bの性能、H100に対してて、1.9倍です。下の方に、準備段階で測定されたパフォーマンスです。変更される可能性があります。とあります。 また、H100 1x GPU BS 8 | H200 1x GPU BS 32 ともあります。GPU、1個だとH100でのメモリは80GB、H200でのメモリは141GBなのでメモリ容量にも影響受けていそうですね。

おわりに

メモリ容量が制約にならないのなら、H100 に対して、H200 はメモリ帯域が増えた分、速くなる感じですかね。。。

H100 => H200 で、1.4倍速くなるのなら、$30,000 と言われているH100に対して、H200は、$35,000 - $40,000 ぐらいになりそうですね。

とは言え、B100 が $30,000 - $40,000 になると革ジャンCEOは公言しているので、H200は $35,000 ぐらいなんですかね。。。ただし、H200はPCIe Boardは無さそうですが。。。